Steigern Sie die LLM-Effizienz: Googles TurboQuant reduziert die Speichernutzung um das Sechsfache

Der neue TurboQuant-Algorithmus von Google reduziert den Speicherbedarf großer Sprachmodelle erheblich und beschleunigt die KI-Leistung ohne Einbußen bei der Genauigkeit.

Google Research hat einen bahnbrechenden Komprimierungsalgorithmus namens TurboQuant vorgestellt, der die Speichernutzung von großen Sprachmodellen (LLMs) drastisch um das Sechsfache reduzieren kann und gleichzeitig die Geschwindigkeit erhöht und die Genauigkeit beibehält.

LLMs, die KI-Modelle, die fortgeschrittene Sprachaufgaben wie die Verarbeitung und Generierung natürlicher Sprache unterstützen, sind für ihren unersättlichen Speicherbedarf bekannt. Der Schlüsselwert-Cache, der wichtige Informationen speichert, um wiederholte Berechnungen zu vermeiden, ist einer der Hauptverursacher dieses Speicherverbrauchs. TurboQuant möchte dieser Herausforderung begegnen, indem es diesen Spickzettel-ähnlichen Cache komprimiert, ohne die Leistung zu beeinträchtigen.

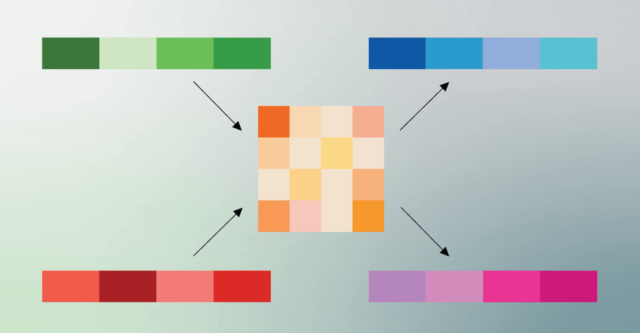

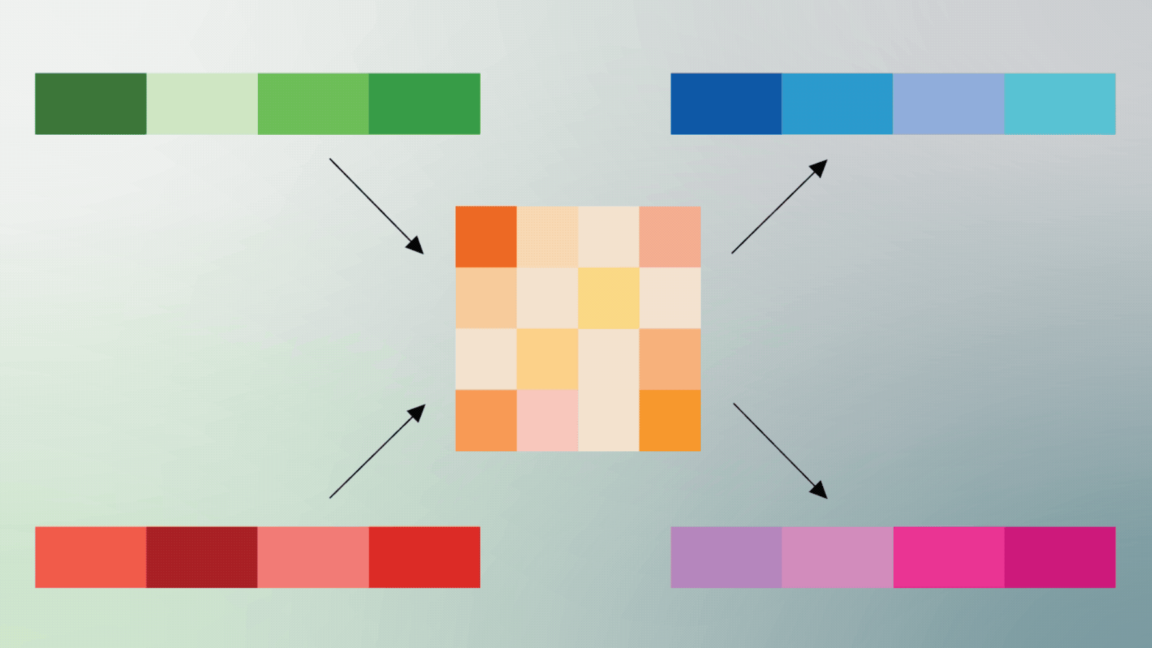

LLMs stützen sich auf hochdimensionale Vektoren, um die semantische Bedeutung von tokenisiertem Text abzubilden. Diese Vektoren, die Hunderte oder Tausende von Einbettungen aufweisen können, werden zur Beschreibung komplexer Informationen wie Bildpixel oder großer Datensätze verwendet. Allerdings belegen sie auch eine beträchtliche Menge an Speicher, was die Größe des Schlüsselwert-Cache erhöht und die Effizienz der Modelle einschränkt.

Um Modelle kleiner und effizienter zu machen, verwenden Entwickler häufig Quantisierung Techniken, um die Präzision dieser Vektoren zu reduzieren. TurboQuant führt dieses Konzept noch einen Schritt weiter und führt einen neuartigen Komprimierungsalgorithmus ein, der den Schlüsselwert-Cache um das bis zu Sechsfache verkleinern kann, ohne die Genauigkeit des Sprachmodells zu beeinträchtigen.

Dieser Durchbruch hat erhebliche Auswirkungen auf die Zukunft der KI. Da LLMs immer größer und komplexer werden, könnte die Möglichkeit, ihren Speicherbedarf drastisch zu reduzieren, neue Grenzen in der KI-Leistung erschließen und sie für eine Vielzahl von Anwendungen zugänglicher und skalierbarer machen.

Der TurboQuant-Algorithmus funktioniert durch eine intelligente Komprimierung des Schlüsselwert-Cache und nutzt fortschrittliche Techniken, um die wesentlichen Informationen beizubehalten und gleichzeitig den Gesamtspeicherbedarf drastisch zu reduzieren. Diese Innovation steigert nicht nur die Effizienz der Modelle, sondern ebnet auch den Weg für leistungsfähigere und zugänglichere KI-gesteuerte Lösungen in der Zukunft.

Da die Nachfrage nach leistungsstarker, speichereffizienter KI weiter wächst, sticht Googles TurboQuant als bahnbrechender Beitrag hervor, der die Landschaft der generativen KI und darüber hinaus neu definieren könnte.

Quelle: Ars Technica