Reportero de la BBC pirateado a través de fallas en la plataforma de codificación de IA

Las vulnerabilidades de seguridad en herramientas populares de codificación de IA exponen a los usuarios a riesgos de piratería, como se demostró cuando un periodista de la BBC fue víctima de fallas en la plataforma.

El mundo en rápida expansión de las plataformas de codificación de IA ha revelado importantes vulnerabilidades de seguridad que plantean graves riesgos para los usuarios, como se ilustró dramáticamente cuando un reportero de la BBC fue víctima de un sofisticado intento de piratería a través de estas mismas herramientas. El incidente pone de relieve las crecientes preocupaciones sobre la infraestructura de seguridad de las plataformas diseñadas para democratizar el desarrollo de aplicaciones para usuarios no técnicos. A medida que estas herramientas de inteligencia artificial sin código ganan fuerza masiva en todas las industrias, los expertos en ciberseguridad están haciendo sonar la alarma sobre posibles vectores de explotación que podrían afectar a millones de usuarios en todo el mundo.

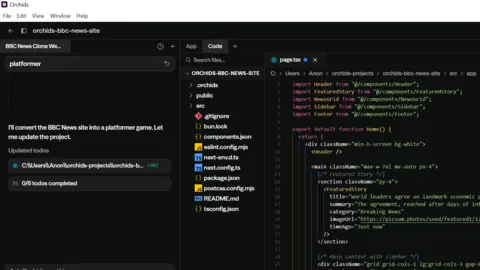

El periodista afectado estaba usando una de las populares plataformas de codificación visual que han ganado popularidad durante el último año, permitiendo a personas sin experiencia en programación crear aplicaciones funcionales a través de la asistencia de inteligencia artificial. Estas plataformas suelen utilizar interfaces de arrastrar y soltar combinadas con generación de código impulsada por IA para transformar las ideas de los usuarios en software funcional. Sin embargo, el incidente reveló que los protocolos de seguridad subyacentes de dichas plataformas pueden no ser lo suficientemente sólidos para proteger a los usuarios de actores maliciosos que entienden cómo explotar el proceso de desarrollo impulsado por IA.

Los investigadores de seguridad que analizaron el hack descubrieron que la vulnerabilidad se debía a una validación de entrada inadecuada dentro del sistema de generación de código de IA. La inteligencia artificial de la plataforma fue diseñada para interpretar solicitudes de lenguaje natural y convertirlas en código funcional, pero carecía de salvaguardias suficientes para evitar la inyección de comandos maliciosos disfrazados de solicitudes de desarrollo legítimas. Esto permitió a los atacantes esencialmente engañar a la IA para que generara código que pudiera acceder a datos confidenciales del usuario y recursos del sistema más allá del alcance previsto de la aplicación que se estaba desarrollando.

Las implicaciones de ciberseguridad de este incidente se extienden mucho más allá de una sola cuenta comprometida. Los analistas de la industria estiman que más de 15 millones de usuarios en todo el mundo están utilizando activamente varias plataformas de codificación impulsadas por IA, y las tasas de adopción aumentan aproximadamente un 300 % año tras año. Las principales plataformas en este espacio incluyen actores establecidos como Power Platform de Microsoft, AppSheet de Google y numerosas nuevas empresas que en conjunto han recaudado miles de millones en financiación de capital de riesgo. La accesibilidad y la facilidad de uso que hacen que estas plataformas sean atractivas para usuarios no técnicos también crean una superficie de ataque más amplia para los ciberdelincuentes.

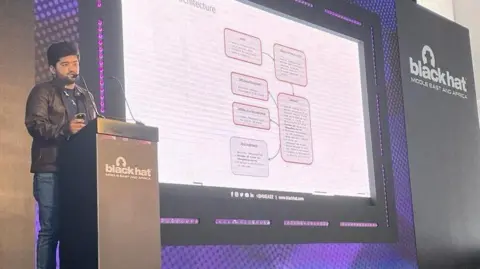

La última investigación de la empresa de ciberseguridad CyberArk indica que las herramientas de desarrollo impulsadas por IA representan una nueva categoría de riesgo de seguridad que los marcos de ciberseguridad tradicionales no han abordado adecuadamente. El director de tecnología de la empresa explicó que estas plataformas crean desafíos únicos porque desdibujan las líneas entre la entrada del usuario y el código ejecutable, lo que dificulta la implementación de medidas de seguridad convencionales sin obstaculizar la experiencia del usuario que hace que estas herramientas sean valiosas en primer lugar.

La experiencia del reportero de la BBC sirve como advertencia para la adopción más amplia de estas tecnologías. Según fuentes familiarizadas con el incidente, el ataque comenzó cuando el periodista intentó crear una aplicación sencilla de visualización de datos utilizando el asistente de inteligencia artificial de la plataforma. Al parecer, el atacante había descubierto un método para insertar instrucciones maliciosas en mensajes de desarrollo aparentemente inocentes, lo que provocó que la IA generara código que establecía conexiones de red no autorizadas y transmitía información confidencial a servidores externos.

Tras el incidente, varias importantes plataformas de codificación de IA Los proveedores han anunciado auditorías de seguridad inmediatas y medidas de protección mejoradas. Las plataformas están implementando una mejor desinfección de las entradas, un monitoreo mejorado del código generado por IA y modelos de permisos más estrictos que limitan el acceso al sistema otorgado a las aplicaciones creadas a través de sus herramientas. Sin embargo, los expertos en seguridad advierten que es posible que estas medidas solo aborden vectores de ataque conocidos, mientras que la naturaleza en rápida evolución de la tecnología de inteligencia artificial podría introducir nuevas vulnerabilidades más rápido de lo que pueden identificarse y repararse.

El impacto económico de estas preocupaciones de seguridad ya se está volviendo evidente en el mercado. Según se informa, las empresas de capital de riesgo que han invertido mucho en el espacio de codificación sin código y con IA están realizando evaluaciones de seguridad de emergencia de las empresas de su cartera. Varios clientes empresariales han suspendido temporalmente el uso de ciertas plataformas en espera de revisiones exhaustivas de seguridad, lo que podría afectar las proyecciones de ingresos de las empresas en este sector de rápido crecimiento.

Dr. Sarah Chen, investigadora de ciberseguridad de la Universidad de Stanford que se especializa en vulnerabilidades de seguridad de la IA, enfatizó que este incidente representa solo el comienzo de una nueva era de amenazas cibernéticas. Su equipo de investigación ha identificado más de 20 posibles vectores de ataque diferentes específicos de las plataformas de codificación de IA, que van desde ataques de inyección rápida hasta técnicas de manipulación de modelos que podrían comprometer la integridad del código generado a escala.

El panorama regulatorio que rodea a las herramientas de desarrollo de IA también está evolucionando en respuesta a estos desafíos de seguridad. La Ley de IA propuesta por la Unión Europea incluye disposiciones específicas para herramientas de desarrollo de software basadas en IA, que requieren una mayor transparencia y medidas de seguridad para las plataformas que permiten a los no expertos crear aplicaciones. En Estados Unidos se están llevando a cabo debates regulatorios similares, y los comités del Congreso examinan si los marcos de ciberseguridad existentes son adecuados para gobernar las plataformas de desarrollo impulsadas por IA.

Los líderes de la industria están pidiendo el establecimiento de protocolos de seguridad estandarizados diseñados específicamente para plataformas de codificación de IA. La propuesta incluye auditorías de seguridad obligatorias, procesos estandarizados de divulgación de vulnerabilidades y el intercambio en toda la industria de inteligencia sobre amenazas relacionadas con métodos de ataque específicos de IA. Sin embargo, la implementación de dichos estándares en el diverso ecosistema de herramientas de codificación de IA presenta importantes desafíos técnicos y logísticos.

El incidente también ha provocado debates más amplios sobre las compensaciones entre accesibilidad y seguridad en el desarrollo de software. Si bien las herramientas de codificación democratizadas han permitido a innumerables personas y pequeñas empresas crear aplicaciones valiosas sin una amplia experiencia técnica, los riesgos de seguridad pueden requerir un replanteamiento fundamental de cómo estas plataformas equilibran la facilidad de uso con medidas de protección sólidas.

Como muestra la investigación del reportero de la BBC El hack continúa, los profesionales de la ciberseguridad están utilizando el incidente como un caso de estudio para desarrollar mejores estrategias de protección para las plataformas de codificación de IA. Se espera que las lecciones aprendidas de esta infracción influyan en el desarrollo de marcos de seguridad de próxima generación diseñados específicamente para abordar los desafíos únicos que plantea la inteligencia artificial en los entornos de desarrollo de software, ayudando en última instancia a garantizar que la democratización de la codificación no se produzca a expensas de la seguridad y la privacidad del usuario.

Fuente: BBC News