Vídeos falsos de IA sobre las inundaciones en las redes sociales del Reino Unido

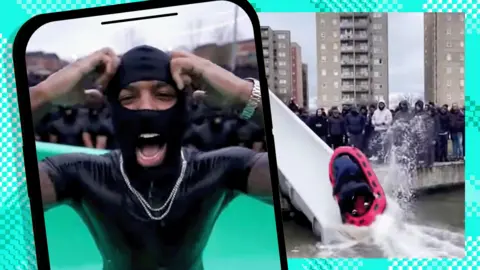

Los vídeos deepfake que muestran el deterioro de las instalaciones públicas del Reino Unido se están difundiendo en las plataformas sociales, provocando reacciones racistas y preocupaciones por la desinformación.

Ha surgido una tendencia inquietante en las plataformas de redes sociales a medida que los videos generados por inteligencia artificial que representan escenas ficticias de decadencia urbana en el Reino Unido continúan proliferando a un ritmo alarmante. Estas sofisticadas producciones deepfake muestran escenarios imaginarios de infraestructura pública en deterioro, instalaciones abandonadas financiadas por los contribuyentes y paisajes urbanos distópicos que se parecen poco a la realidad pero son lo suficientemente convincentes como para engañar a los espectadores ocasionales.

Los videos deepfake se centran principalmente en servicios públicos como parques acuáticos, piscinas, centros comunitarios e instalaciones recreativas que parecen estar en grave estado de deterioro. Estos clips generados por IA muestran estructuras de concreto desmoronadas, agua estancada llena de escombros, tejas rotas y vegetación cubierta de maleza que recupera lo que supuestamente alguna vez fueron espacios públicos prósperos. El nivel de detalle de estas escenas inventadas es notablemente sofisticado e incorpora iluminación realista, efectos climáticos y texturas ambientales que las hacen parecer auténticas para los espectadores desprevenidos.

Lo que hace que estos videos generados por IA sean particularmente preocupantes es su rápida difusión en múltiples plataformas de redes sociales, incluidas TikTok, Twitter, Facebook e Instagram. La naturaleza algorítmica de estas plataformas tiende a amplificar el contenido que genera fuertes respuestas emocionales, y estos videos falsos del deterioro urbano ciertamente logran ese objetivo. Los usuarios los comparten con subtítulos que expresan indignación por el gasto gubernamental, las políticas públicas fallidas y el colapso social, a menudo sin cuestionar su autenticidad ni investigar sus orígenes.

La creación y distribución de estos vídeos falsos de IA parece ser parte de un esfuerzo coordinado para manipular la opinión pública sobre el desarrollo urbano, el gasto gubernamental y las políticas sociales en el Reino Unido. Muchos de los videos van acompañados de subtítulos engañosos que afirman mostrar los resultados de decisiones políticas específicas o el estado actual de vecindarios particulares, a pesar de ser completamente inventados. Esta campaña de desinformación explota las preocupaciones existentes de la gente sobre el gasto público y el desarrollo urbano para difundir narrativas falsas.

Quizás lo más preocupante es la forma en que estos videos deepfake se han convertido en vehículos para comentarios racistas y retórica discriminatoria. Las secciones de comentarios debajo de estos clips virales suelen estar llenas de respuestas incendiarias que culpan a comunidades étnicas, inmigrantes o grupos minoritarios específicos por la decadencia ficticia que se muestra en los videos. Esta reacción racista demuestra cómo el contenido sofisticado generado por IA puede usarse como arma para promover ideologías divisivas y reforzar estereotipos dañinos sobre diferentes comunidades.

Los usuarios de las redes sociales que ven estos videos a menudo reaccionan con genuina conmoción y consternación, creyendo que están presenciando evidencia real de colapso social o políticas gubernamentales fallidas. El impacto emocional de ver lo que parece ser dinero de los contribuyentes desperdiciado en una infraestructura en ruinas desencadena fuertes reacciones que los usuarios se sienten obligados a compartir con sus redes. Este mecanismo viral garantiza que la información errónea generada por IA llegue a audiencias cada vez mayores, amplificando su potencial de daño.

La sofisticación técnica de estos deepfakes representa un avance significativo en la tecnología de generación de videos de IA. A diferencia de ejemplos anteriores de medios sintéticos que contenían inconsistencias o artefactos visuales obvios, estas nuevas producciones demuestran una calidad mejorada en términos de representación de texturas, consistencia de iluminación y coherencia temporal. Los creadores parecen estar utilizando redes generativas adversarias (GAN) avanzadas o modelos similares de aprendizaje automático entrenados en extensos conjuntos de datos de entornos urbanos reales y escenarios de decadencia.

Los expertos en detección de medios sintéticos advierten que identificar estos vídeos generados por IA es cada vez más difícil para el usuario medio. Los signos reveladores tradicionales de contenido deepfake, como movimientos faciales antinaturales o iluminación inconsistente, son menos relevantes cuando los videos se centran en objetos inanimados y escenas ambientales. La falta de sujetos humanos en muchos de estos videos elimina algunos de los métodos de detección más confiables que los investigadores y verificadores de datos suelen emplear.

El fenómeno refleja desafíos más amplios que enfrenta la sociedad a medida que la tecnología de IA se vuelve más accesible y sofisticada. Las herramientas necesarias para crear vídeos deepfake convincentes ya no se limitan a organizaciones bien financiadas o especialistas altamente técnicos. El software de consumo y los servicios de IA basados en la nube han democratizado la creación de medios sintéticos, haciendo posible que personas con habilidades técnicas modestas y recursos limitados produzcan contenido falso convincente.

Los funcionarios gubernamentales y los defensores de la alfabetización mediática están expresando una creciente preocupación por el impacto potencial de esta desinformación generada por la IA en el discurso público y los procesos democráticos. Cuando los ciudadanos basan sus opiniones políticas y decisiones electorales en información falsa que parece auténtica, la integridad de las instituciones democráticas puede verse socavada. La naturaleza viral de estos videos falsos significa que las correcciones y verificaciones de hechos a menudo no logran llegar a las mismas audiencias que vieron el contenido engañoso original.

Las plataformas de redes sociales están luchando por desarrollar respuestas efectivas a esta nueva forma de manipulación sintética de los medios. Los enfoques tradicionales de moderación de contenido que se basan en informes de usuarios y revisores humanos son insuficientes para abordar la escala y la sofisticación de la información errónea generada por la IA. Los sistemas de detección automatizados todavía están en su infancia y a menudo no logran identificar deepfakes convincentes, particularmente aquellos que no presentan sujetos humanos.

Los creadores de estos vídeos deepfake a menudo operan de forma anónima y utilizan técnicas para ocultar sus identidades y motivaciones. Algunos parecen estar motivados por agendas políticas, mientras que otros pueden buscar generar participación e ingresos a través de contenido viral. La naturaleza internacional de las plataformas de redes sociales dificulta que las autoridades investiguen y procesen a los responsables de crear y distribuir contenido engañoso generado por IA.

Las instituciones educativas y las organizaciones de alfabetización mediática están trabajando para desarrollar nuevos planes de estudio y recursos para ayudar a las personas a identificar medios sintéticos y pensar críticamente sobre el contenido que encuentran en línea. Sin embargo, el rápido ritmo del avance tecnológico significa que las técnicas de detección y los materiales educativos a menudo van a la zaga de las últimas capacidades de deepfake. Enseñar a las personas a cuestionar la autenticidad de videos aparentemente realistas representa un cambio fundamental en la forma en que abordamos el consumo de medios.

No se debe subestimar el impacto psicológico de la exposición a estos videos falsos. Incluso cuando las personas se enteran más tarde de que el contenido fue generado artificialmente, la respuesta emocional inicial y las imágenes mentales pueden persistir e influir en sus percepciones de la realidad. Este fenómeno, conocido como "efecto de verdad ilusoria", significa que la exposición repetida a información falsa puede hacer que parezca más creíble con el tiempo, independientemente de su exactitud real.

Los investigadores que estudian la difusión de información errónea generada por IA señalan que estos videos explotan las ansiedades sociales existentes sobre el deterioro urbano, el gasto gubernamental y la seguridad de la comunidad. Al presentar escenarios ficticios que se alinean con los miedos y preconceptos existentes de las personas, los creadores aumentan la probabilidad de que los espectadores acepten el contenido como auténtico y lo compartan con otras personas que tienen inquietudes similares.

Las implicaciones internacionales de esta tendencia se extienden más allá del Reino Unido, ya que se podrían emplear tácticas similares para manipular la opinión pública en otros países. Las técnicas utilizadas para crear estos convincentes vídeos falsos sobre la decadencia urbana podrían adaptarse fácilmente para dirigirse a diferentes naciones, comunidades o sistemas políticos. Esto representa una nueva frontera en la guerra de información y propaganda que requiere respuestas internacionales coordinadas.

Fuente: BBC News