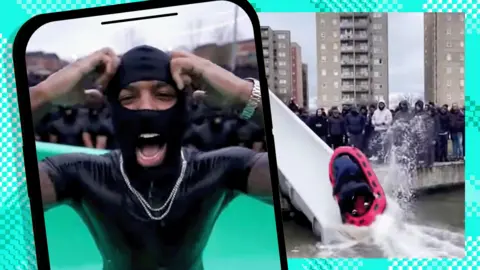

Video falsi basati sull'intelligenza artificiale del degrado urbano del Regno Unito che inondano i social media

I video deepfake che descrivono le strutture pubbliche del Regno Unito in deterioramento si stanno diffondendo su piattaforme social, scatenando reazioni razziste e preoccupazioni di disinformazione.

È emersa una tendenza inquietante sulle piattaforme dei social media poiché video generati dall'intelligenza artificiale che raffigurano scene immaginarie del degrado urbano nel Regno Unito continuano a proliferare a un ritmo allarmante. Queste sofisticate produzioni deepfake mostrano scenari immaginari di infrastrutture pubbliche in deterioramento, strutture abbandonate finanziate dai contribuenti e paesaggi urbani distopici che hanno poca somiglianza con la realtà ma sono abbastanza convincenti da ingannare gli spettatori occasionali.

I video deepfake si concentrano principalmente su servizi pubblici come parchi acquatici, piscine, centri comunitari e strutture ricreative che sembrano essere in stato di grave rovina. Queste clip generate dall’intelligenza artificiale mostrano strutture di cemento fatiscenti, acqua stagnante piena di detriti, piastrelle rotte e vegetazione incolta che reclamano quelli che un tempo erano spazi pubblici presumibilmente fiorenti. Il livello di dettaglio in queste scene fabbricate è straordinariamente sofisticato e incorpora illuminazione realistica, effetti meteorologici e trame ambientali che le fanno sembrare autentiche agli spettatori ignari.

Ciò che rende questi video generati dall'intelligenza artificiale particolarmente preoccupanti è la loro rapida diffusione su più piattaforme di social media, tra cui TikTok, Twitter, Facebook e Instagram. La natura algoritmica di queste piattaforme tende ad amplificare contenuti che generano forti risposte emotive, e questi falsi video sul declino urbano raggiungono sicuramente questo obiettivo. Gli utenti li condividono con didascalie che esprimono indignazione per la spesa pubblica, le politiche pubbliche fallite e il collasso sociale, spesso senza metterne in dubbio l'autenticità o indagarne le origini.

La creazione e la distribuzione di questi video falsi sull'intelligenza artificiale sembra essere parte di uno sforzo coordinato per manipolare l'opinione pubblica sullo sviluppo urbano, sulla spesa pubblica e sulle politiche sociali nel Regno Unito. Molti video sono accompagnati da didascalie fuorvianti che pretendono di mostrare i risultati di specifiche decisioni politiche o lo stato attuale di particolari quartieri, nonostante siano interamente inventate. Questa campagna di disinformazione sfrutta le preoccupazioni esistenti delle persone sulla spesa pubblica e sullo sviluppo urbano per diffondere false narrazioni.

Forse la cosa più preoccupante è il modo in cui questi video deepfake sono diventati veicoli di commenti razzisti e retorica discriminatoria. Le sezioni dei commenti sotto queste clip virali sono spesso piene di risposte provocatorie che incolpano specifiche comunità etniche, immigrati o gruppi minoritari per il decadimento immaginario rappresentato nei video. Questa reazione razzista dimostra come i sofisticati contenuti generati dall'intelligenza artificiale possano essere utilizzati come armi per promuovere ideologie divisive e rafforzare stereotipi dannosi sulle diverse comunità.

Gli utenti dei social media che vedono questi video spesso reagiscono con autentico shock e sgomento, credendo di essere testimoni di prove reali del collasso sociale o di politiche governative fallite. L’impatto emotivo nel vedere quello che sembra essere il denaro dei contribuenti sprecato in infrastrutture fatiscenti innesca forti reazioni che gli utenti si sentono obbligati a condividere con le loro reti. Questo meccanismo virale garantisce che la disinformazione generata dall'intelligenza artificiale raggiunga un pubblico sempre più vasto, amplificandone il potenziale dannoso.

La sofisticazione tecnica di questi deepfake rappresenta un progresso significativo nella tecnologia di generazione di video AI. A differenza dei precedenti esempi di media sintetici che contenevano evidenti artefatti visivi o incoerenze, queste nuove produzioni dimostrano una migliore qualità in termini di resa delle texture, coerenza dell'illuminazione e coerenza temporale. Sembra che i creatori utilizzino reti generative avversarie (GAN) avanzate o modelli simili di apprendimento automatico addestrati su estesi set di dati di ambienti urbani reali e scenari di degrado.

Gli esperti nel rilevamento dei media sintetici avvertono che identificare questi video generati dall'intelligenza artificiale sta diventando sempre più difficile per gli utenti medi. I tradizionali segni rivelatori di contenuti deepfake, come movimenti facciali innaturali o illuminazione incoerente, sono meno rilevanti quando i video si concentrano su oggetti inanimati e scene ambientali. La mancanza di soggetti umani in molti di questi video elimina alcuni dei metodi di rilevamento più affidabili utilizzati solitamente da ricercatori e verificatori di fatti.

Il fenomeno riflette sfide più ampie che la società deve affrontare man mano che la tecnologia AI diventa sempre più accessibile e sofisticata. Gli strumenti necessari per creare video deepfake convincenti non sono più limitati a organizzazioni ben finanziate o specialisti altamente tecnici. I software di livello consumer e i servizi di intelligenza artificiale basati su cloud hanno democratizzato la creazione di media sintetici, consentendo a individui con modeste competenze tecniche e risorse limitate di produrre contenuti falsi convincenti.

Funzionari governativi e sostenitori dell'alfabetizzazione mediatica esprimono crescente preoccupazione per il potenziale impatto di questa disinformazione generata dall'intelligenza artificiale sul discorso pubblico e sui processi democratici. Quando i cittadini basano le loro opinioni politiche e le decisioni di voto su informazioni false che appaiono autentiche, l’integrità delle istituzioni democratiche può essere minata. La natura virale di questi video falsi fa sì che correzioni e verifiche dei fatti spesso non riescano a raggiungere lo stesso pubblico che ha visualizzato i contenuti fuorvianti originali.

Le piattaforme di social media stanno lottando per sviluppare risposte efficaci a questa nuova forma di manipolazione dei media sintetici. Gli approcci tradizionali di moderazione dei contenuti che si basano sulla segnalazione degli utenti e sui revisori umani non sono sufficienti per affrontare la portata e la sofisticatezza della disinformazione generata dall’intelligenza artificiale. I sistemi di rilevamento automatizzato sono ancora agli inizi e spesso non riescono a identificare deepfake convincenti, in particolare quelli che non presentano soggetti umani.

I creatori di questi video deepfake spesso operano in modo anonimo e utilizzano tecniche per oscurare le loro identità e motivazioni. Alcuni sembrano essere motivati da agende politiche, mentre altri potrebbero cercare di generare coinvolgimento ed entrate attraverso contenuti virali. La natura internazionale delle piattaforme di social media rende difficile per le autorità indagare e perseguire i responsabili della creazione e distribuzione di contenuti fuorvianti generati dall'intelligenza artificiale.

Istituzioni educative e organizzazioni di alfabetizzazione mediatica stanno lavorando per sviluppare nuovi programmi di studio e risorse per aiutare le persone a identificare i media sintetici e a pensare in modo critico ai contenuti che incontrano online. Tuttavia, il rapido ritmo del progresso tecnologico fa sì che le tecniche di rilevamento e i materiali didattici spesso restino indietro rispetto alle più recenti funzionalità di deepfake. Insegnare alle persone a mettere in dubbio l'autenticità di video apparentemente realistici rappresenta un cambiamento fondamentale nel modo in cui affrontiamo il consumo dei media.

L'impatto psicologico dell'esposizione a questi video falsi non dovrebbe essere sottovalutato. Anche quando le persone apprendono in seguito che il contenuto è stato generato artificialmente, la risposta emotiva iniziale e le immagini mentali possono persistere e influenzare la loro percezione della realtà. Questo fenomeno, noto come "effetto verità illusoria", significa che l'esposizione ripetuta a informazioni false può farle sembrare più credibili nel tempo, indipendentemente dalla loro effettiva accuratezza.

I ricercatori che studiano la diffusione della disinformazione generata dall'intelligenza artificiale notano che questi video sfruttano le ansie sociali esistenti riguardo al declino urbano, alla spesa pubblica e alla sicurezza della comunità. Presentando scenari immaginari in linea con le paure e i preconcetti esistenti delle persone, i creatori aumentano la probabilità che gli spettatori accettino i contenuti come autentici e li condividano con altri che nutrono preoccupazioni simili.

Le implicazioni internazionali di questa tendenza si estendono oltre il Regno Unito, poiché tattiche simili potrebbero essere impiegate per manipolare l'opinione pubblica in altri paesi. Le tecniche utilizzate per creare questi convincenti video falsi sul degrado urbano potrebbero essere facilmente adattate per prendere di mira diverse nazioni, comunità o sistemi politici. Ciò rappresenta una nuova frontiera nella guerra dell'informazione e nella propaganda che richiede risposte internazionali coordinate.

Fonte: BBC News