Репортера BBC взломали из-за недостатков платформы кодирования искусственного интеллекта

Уязвимости безопасности в популярных инструментах кодирования искусственного интеллекта подвергают пользователей риску взлома, о чем свидетельствует случай, когда журналист BBC стал жертвой недостатков платформы.

Быстро расширяющийся мир платформ для кодирования искусственного интеллекта выявил значительные уязвимости безопасности, которые представляют серьезную угрозу для пользователей, о чем наглядно свидетельствует случай, когда репортер BBC стал жертвой изощренной попытки взлома с помощью этих самых инструментов. Этот инцидент подчеркивает растущую обеспокоенность по поводу инфраструктуры безопасности платформ, предназначенных для демократизации разработки приложений для нетехнических пользователей. Поскольку эти инструменты искусственного интеллекта без кода набирают все большую популярность в различных отраслях, эксперты по кибербезопасности бьют тревогу по поводу потенциальных векторов эксплуатации, которые могут затронуть миллионы пользователей по всему миру.

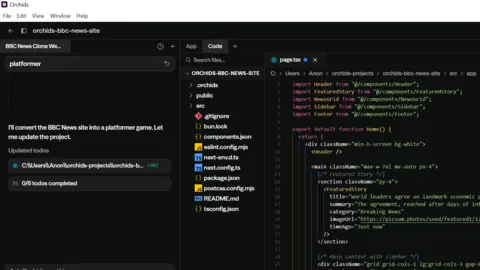

Пострадавший журналист использовал одну из популярных платформ визуального кодирования, популярность которых резко возросла за последний год, позволяя людям без опыта программирования создавать функциональные приложения с помощью искусственного интеллекта. Эти платформы обычно используют интерфейсы перетаскивания в сочетании с генерацией кода на основе искусственного интеллекта для преобразования пользовательских идей в работающее программное обеспечение. Однако инцидент показал, что базовые протоколы безопасности таких платформ могут быть недостаточно надежными, чтобы защитить пользователей от злоумышленников, которые понимают, как использовать процесс разработки, управляемый искусственным интеллектом.

Исследователи безопасности, проанализировавшие взлом, обнаружили, что уязвимость возникла из-за неадекватной проверки входных данных в системе генерации кода искусственного интеллекта. Искусственный интеллект платформы был разработан для интерпретации запросов на естественном языке и преобразования их в функциональный код, но ему не хватало достаточных мер защиты для предотвращения внедрения вредоносных команд, замаскированных под законные запросы разработки. Это позволило злоумышленникам обманом заставить ИИ генерировать код, который мог бы получить доступ к конфиденциальным пользовательским данным и системным ресурсам, выходящим за рамки предполагаемого объема разрабатываемого приложения.

Последствия этого инцидента для кибербезопасности выходят далеко за рамки одной взломанной учетной записи. По оценкам отраслевых аналитиков, более 15 миллионов пользователей по всему миру в настоящее время активно используют различные платформы кодирования на базе искусственного интеллекта, причем уровень внедрения увеличивается примерно на 300% по сравнению с прошлым годом. К основным платформам в этой сфере относятся признанные игроки, такие как Power Platform от Microsoft, AppSheet от Google, а также многочисленные стартапы, которые в совокупности собрали миллиарды долларов венчурного финансирования. Доступность и простота использования, которые делают эти платформы привлекательными для нетехнических пользователей, также создают более широкую поверхность атаки для киберпреступников.

Последние исследования компании CyberArk, занимающейся кибербезопасностью, показывают, что инструменты разработки на базе искусственного интеллекта представляют собой новую категорию угроз безопасности, с которой традиционные системы кибербезопасности не справляются должным образом. Технический директор компании объяснил, что эти платформы создают уникальные проблемы, поскольку они стирают границы между пользовательским вводом и исполняемым кодом, что затрудняет реализацию обычных мер безопасности, не мешая при этом пользовательскому опыту, что в первую очередь делает эти инструменты ценными.

Опыт репортера BBC служит предостережением для более широкого внедрения этих технологий. По данным источников, знакомых с инцидентом, атака началась, когда журналист попытался создать простое приложение для визуализации данных с помощью искусственного интеллекта платформы. Злоумышленник, по-видимому, обнаружил способ встраивания вредоносных инструкций в, казалось бы, невинные запросы разработки, в результате чего ИИ генерировал код, который устанавливал несанкционированные сетевые подключения и передавал конфиденциальную информацию на внешние серверы.

После инцидента несколько крупных ИИ Поставщики платформ кодирования объявили о немедленных проверках безопасности и усилении мер защиты. Платформы реализуют улучшенную очистку входных данных, улучшенный мониторинг кода, сгенерированного ИИ, и более строгие модели разрешений, которые ограничивают доступ к системе, предоставляемый приложениям, созданным с помощью их инструментов. Однако эксперты по безопасности предупреждают, что эти меры могут быть направлены только на известные векторы атак, в то время как быстро развивающаяся природа технологии искусственного интеллекта может привести к появлению новых уязвимостей быстрее, чем их можно будет идентифицировать и исправить.

Экономическое воздействие этих проблем безопасности уже становится очевидным на рынке. Сообщается, что венчурные фирмы, которые вложили значительные средства в области кодирования без кода и искусственного интеллекта, проводят экстренную оценку безопасности своих портфельных компаний. Несколько корпоративных клиентов временно приостановили использование определенных платформ в ожидании комплексной проверки безопасности, что потенциально может повлиять на прогнозы доходов компаний в этом быстрорастущем секторе.

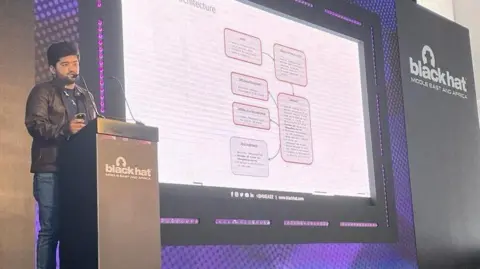

Д-р. Сара Чен, исследователь кибербезопасности из Стэнфордского университета, специализирующаяся на уязвимостях безопасности искусственного интеллекта, подчеркнула, что этот инцидент представляет собой лишь начало новой эры киберугроз. Ее исследовательская группа выявила более 20 различных потенциальных векторов атак, специфичных для платформ кодирования искусственного интеллекта: от атак с быстрым внедрением до методов манипулирования моделями, которые могут поставить под угрозу целостность сгенерированного кода в большом масштабе.

Регуляторная среда, окружающая инструменты разработки ИИ, также развивается в ответ на это этим вызовам безопасности. Предлагаемый Европейским Союзом Закон об искусственном интеллекте включает конкретные положения об инструментах разработки программного обеспечения на основе искусственного интеллекта, требуя повышенной прозрачности и мер безопасности для платформ, которые позволяют неспециалистам создавать приложения. Аналогичные нормативные дискуссии ведутся в Соединенных Штатах: комитеты Конгресса изучают, подходят ли существующие структуры кибербезопасности для управления платформами разработки на базе ИИ.

Лидеры отрасли призывают к созданию стандартизированных протоколов безопасности, специально разработанных для платформ кодирования ИИ. Предложение включает обязательные аудиты безопасности, стандартизированные процессы раскрытия уязвимостей и обмен данными об угрозах, связанных с методами атак, специфичными для ИИ, в масштабах всей отрасли. Однако внедрение таких стандартов в разнообразную экосистему инструментов ИИ-кодирования представляет собой серьезные технические и логистические проблемы.

Инцидент также вызвал более широкие дискуссии о компромиссе между доступностью и безопасностью при разработке программного обеспечения. Хотя демократизированные инструменты программирования позволили бесчисленному количеству людей и малых предприятий создавать ценные приложения без обширных технических знаний, риски безопасности могут потребовать фундаментального переосмысления того, как эти платформы сочетают простоту использования с надежными мерами защиты.

Как расследование BBC Взлом репортера продолжается, специалисты по кибербезопасности используют этот инцидент в качестве примера для разработки более эффективных стратегий защиты платформ кодирования ИИ. Ожидается, что уроки, извлеченные из этого нарушения, повлияют на разработку инфраструктур безопасности следующего поколения, специально предназначенных для решения уникальных проблем, связанных с искусственным интеллектом в средах разработки программного обеспечения, что в конечном итоге поможет гарантировать, что демократизация кодирования не происходит за счет безопасности и конфиденциальности пользователей.

Источник: BBC News