Повышение эффективности LLM: Google TurboQuant сокращает использование памяти в 6 раз

Новый алгоритм Google TurboQuant значительно сокращает объем памяти, занимаемый большими языковыми моделями, повышая производительность ИИ без ущерба для точности.

Google Research представила новаторский алгоритм сжатия под названием TurboQuant, который может значительно сократить использование памяти большими языковыми моделями (LLM) до 6 раз, одновременно повышая скорость и сохраняя точность.

LLM, модели искусственного интеллекта, обеспечивающие сложные языковые задачи, такие как обработка и генерация естественного языка, известны своей ненасытной потребностью в памяти. Кэш «ключ-значение», в котором хранится важная информация, позволяющая избежать повторных вычислений, является основным виновником такого потребления памяти. TurboQuant стремится решить эту проблему, сжимая этот кэш, похожий на шпаргалку, без ущерба для производительности.

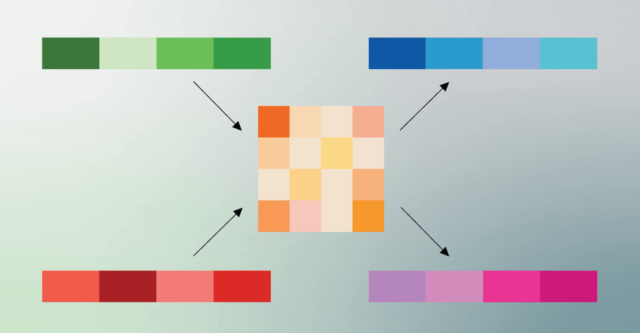

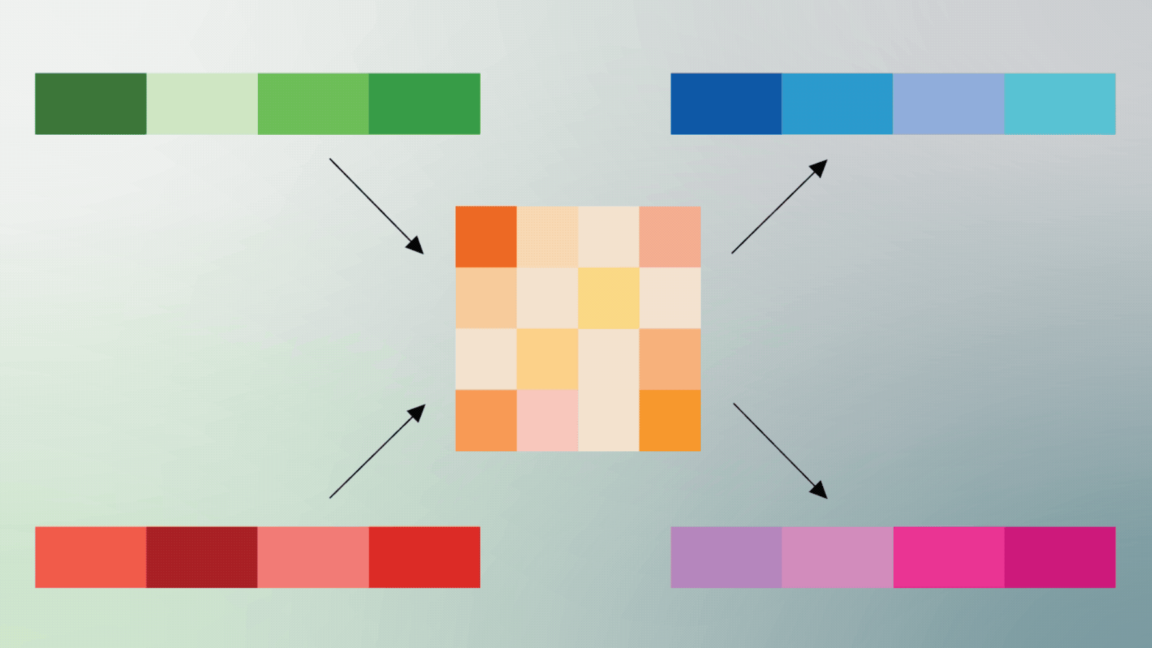

LLM полагаются на многомерные векторы для отображения семантического значения токенизированного текста. Эти векторы, которые могут иметь сотни или тысячи вложений, используются для описания сложной информации, такой как пиксели изображения или большие наборы данных. Однако они также занимают значительный объем памяти, увеличивая размер кэша ключей и ограничивая эффективность моделей.

Чтобы сделать модели меньше и эффективнее, разработчики часто используют методы квантования для снижения точности этих векторов. TurboQuant развивает эту концепцию еще дальше, представляя новый алгоритм сжатия, который может уменьшить кеш ключ-значение до 6 раз без ущерба для точности языковой модели.

Этот прорыв имеет серьезные последствия для будущего искусственного интеллекта. Поскольку LLM продолжают расти в размере и сложности, возможность резко сократить объем используемой ими памяти может открыть новые горизонты в производительности ИИ, сделав его более доступным и масштабируемым для широкого спектра приложений.

Алгоритм TurboQuant работает путем интеллектуального сжатия кэша «ключ-значение», используя передовые методы для сохранения важной информации, одновременно радикально сокращая общие требования к памяти. Это нововведение не только повышает эффективность моделей, но и открывает путь к более мощным и доступным решениям на основе искусственного интеллекта в будущем.

Поскольку спрос на высокопроизводительный и эффективно использующий память искусственный интеллект продолжает расти, Google TurboQuant выделяется как новаторский вклад, который может переопределить ландшафт генеративного искусственного интеллекта и не только.

Источник: Ars Technica