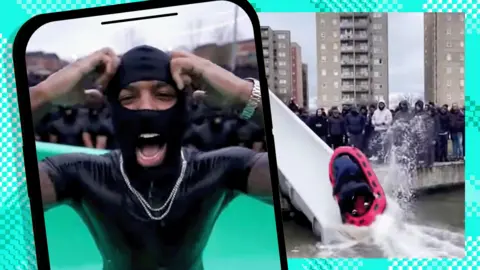

Фейковые видеоролики искусственного интеллекта о наводнении в Великобритании в социальных сетях

Дипфейковые видеоролики, изображающие ухудшение состояния общественных объектов Великобритании, распространяются по социальным платформам, вызывая расистскую реакцию и опасения по поводу дезинформации.

На платформах социальных сетей возникла тревожная тенденция: видео, созданные с помощью искусственного интеллекта, изображающие вымышленные сцены упадка городов в Соединенном Королевстве, продолжают распространяться с угрожающей скоростью. Эти изощренные дипфейки демонстрируют воображаемые сценарии ухудшения общественной инфраструктуры, заброшенных объектов, финансируемых налогоплательщиками, и мрачных городских пейзажей, которые мало похожи на реальность, но достаточно убедительны, чтобы обмануть обычных зрителей.

В дипфейковых видеороликах основное внимание уделяется общественным объектам, таким как аквапарки, бассейны, общественные центры и места отдыха, которые, по всей видимости, находятся в серьезном ветхом состоянии. На этих видеороликах, созданных искусственным интеллектом, показаны разрушающиеся бетонные конструкции, застойная вода, наполненная мусором, разбитая плитка и заросшая растительность, восстанавливающая то, что предположительно когда-то было процветающими общественными пространствами. Уровень детализации этих сфабрикованных сцен чрезвычайно сложен: реалистичное освещение, погодные эффекты и текстуры окружающей среды делают их аутентичными для ничего не подозревающих зрителей.

Что делает эти видео, созданные искусственным интеллектом, особенно тревожными, так это их быстрое распространение на различных платформах социальных сетей, включая TikTok, Twitter, Facebook и Instagram. Алгоритмическая природа этих платформ имеет тенденцию усиливать контент, вызывающий сильные эмоциональные реакции, и эти фейковые видео о городском упадке, безусловно, достигают этой цели. Пользователи делятся ими с подписями, выражающими возмущение по поводу государственных расходов, неудачной государственной политики и социального развала, часто не ставя под сомнение их подлинность и не расследуя их происхождение.

Создание и распространение этих фейковых видео с искусственным интеллектом, по всей видимости, является частью скоординированных усилий по манипулированию общественным мнением о городском развитии, государственных расходах и социальной политике в Великобритании. Многие видео сопровождаются вводящими в заблуждение подписями, в которых утверждается, что показаны результаты конкретных политических решений или текущее состояние конкретных районов, хотя они полностью сфабрикованы. Эта кампания по дезинформации использует существующие опасения людей по поводу государственных расходов и городского развития для распространения ложных историй.

Возможно, больше всего беспокоит то, что эти дипфейковые видео стали средством расистских комментариев и дискриминационной риторики. Разделы комментариев под этими вирусными роликами часто наполнены подстрекательскими ответами, в которых обвиняются конкретные этнические общины, иммигранты или группы меньшинств в вымышленном упадке, изображенном в видеороликах. Эта расистская реакция демонстрирует, как сложный контент, созданный искусственным интеллектом, можно использовать в качестве оружия для продвижения разъединяющих идеологий и укрепления вредных стереотипов о различных сообществах.

Пользователи социальных сетей, которые сталкиваются с этими видео, часто реагируют с искренним шоком и тревогой, полагая, что они являются свидетелями реального распада общества или провала государственной политики. Эмоциональное воздействие того, что деньги налогоплательщиков тратятся на разрушение инфраструктуры, вызывает сильную реакцию, которой пользователи вынуждены поделиться со своими сетями. Этот вирусный механизм гарантирует, что дезинформация, создаваемая искусственным интеллектом, достигнет все более широкой аудитории, увеличивая ее потенциальный вред.

Техническая сложность этих дипфейков представляет собой значительный прогресс в технологии создания видео с помощью искусственного интеллекта. В отличие от более ранних примеров синтетических носителей, которые содержали очевидные визуальные артефакты или несоответствия, эти новые произведения демонстрируют улучшенное качество с точки зрения рендеринга текстур, согласованности освещения и временной согласованности. Создатели, похоже, используют передовые генеративно-состязательные сети (GAN) или аналогичные модели машинного обучения, обученные на обширных наборах данных о реальной городской среде и сценариях разрушения.

Эксперты в области обнаружения синтетических медиа предупреждают, что идентифицировать эти видео, созданные искусственным интеллектом, становится все труднее для обычных пользователей. Традиционные признаки дипфейкового контента, такие как неестественные движения лица или нестабильное освещение, менее актуальны, когда видео фокусируется на неодушевленных объектах и сценах окружающей среды. Отсутствие людей на многих из этих видео исключает некоторые из наиболее надежных методов обнаружения, которые обычно используют исследователи и специалисты по проверке фактов.

Этот феномен отражает более широкие проблемы, стоящие перед обществом по мере того, как технология ИИ становится более доступной и сложной. Инструменты, необходимые для создания убедительных дипфейковых видеороликов, больше не ограничиваются хорошо финансируемыми организациями или высокотехническими специалистами. Программное обеспечение потребительского уровня и облачные службы искусственного интеллекта демократизировали создание синтетических медиа, позволяя людям со скромными техническими навыками и ограниченными ресурсами создавать убедительный фейковый контент.

Правительственные чиновники и сторонники медиаграмотности выражают растущую обеспокоенность по поводу потенциального воздействия этой дезинформации, создаваемой искусственным интеллектом, на общественный дискурс и демократические процессы. Когда граждане основывают свои политические взгляды и решения на голосовании на ложной информации, которая выглядит достоверной, целостность демократических институтов может быть подорвана. Вирусная природа этих фейковых видео означает, что исправления и проверки фактов часто не достигают той же аудитории, которая просматривала исходный вводящий в заблуждение контент.

Платформы социальных сетей изо всех сил пытаются разработать эффективные меры реагирования на эту новую форму синтетического манипулирования СМИ. Традиционные подходы к модерации контента, основанные на сообщениях пользователей и рецензентах-людях, недостаточны для решения проблемы масштаба и сложности дезинформации, генерируемой ИИ. Автоматизированные системы обнаружения все еще находятся в зачаточном состоянии и часто не могут распознать убедительные дипфейки, особенно те, в которых нет людей.

Создатели этих дипфейковых видео часто действуют анонимно и используют методы, чтобы скрыть свою личность и мотивацию. Некоторые, похоже, руководствуются политическими интересами, в то время как другие могут стремиться привлечь внимание и получить доход с помощью вирусного контента. Международный характер платформ социальных сетей затрудняет властям расследование и судебное преследование лиц, ответственных за создание и распространение вводящего в заблуждение контента, созданного искусственным интеллектом.

Образовательные учреждения и организации по медиаграмотности работают над разработкой новых учебные программы и ресурсы, которые помогут людям выявлять синтетические медиа и критически относиться к контенту, с которым они сталкиваются в Интернете. Однако быстрые темпы технологического прогресса означают, что методы обнаружения и учебные материалы часто отстают от новейших возможностей дипфейков. Обучение людей подвергать сомнению подлинность, казалось бы, реалистичных видеороликов представляет собой фундаментальный сдвиг в нашем подходе к медиапотреблению.

Психологическое воздействие этих фейковых видеороликов не следует недооценивать. Даже когда позже люди узнают, что контент был создан искусственно, первоначальные эмоциональные реакции и мысленные образы могут сохраняться и влиять на их восприятие реальности. Это явление, известное как «эффект иллюзорной правды», означает, что повторное воздействие ложной информации со временем может сделать ее более достоверной, независимо от ее фактической точности.

Исследователи, изучающие распространение дезинформации, создаваемой искусственным интеллектом, отмечают, что эти видеоролики используют существующие социальные опасения по поводу упадка городов, государственных расходов и общественной безопасности. Представляя вымышленные сценарии, которые соответствуют существующим страхам и предубеждениям людей, создатели повышают вероятность того, что зрители примут контент за аутентичный и поделятся им с теми, кто разделяет аналогичные опасения.

Международные последствия этой тенденции выходят за пределы Великобритании, поскольку подобная тактика может быть использована для манипулирования общественным мнением в других странах. Техники, используемые для создания этих убедительных фейковых видеороликов об упадке городов, можно легко адаптировать для различных стран, сообществ или политических систем. Это представляет собой новый рубеж информационной войны и пропаганды, требующий скоординированных международных действий.

Источник: BBC News