BBC Muhabiri Yapay Zeka Kodlama Platformu Kusurlarıyla Hacklendi

Popüler yapay zeka kodlama araçlarındaki güvenlik açıkları, bir BBC muhabirinin platform kusurlarının kurbanı olmasında da görüldüğü gibi, kullanıcıları bilgisayar korsanlığı risklerine maruz bırakıyor.

Yapay zeka kodlama platformlarının hızla genişleyen dünyası, kullanıcılar için ciddi riskler oluşturan önemli güvenlik açıklarını ortaya çıkardı; bu, bir BBC muhabirinin bu araçlar aracılığıyla yapılan karmaşık bir bilgisayar korsanlığı girişiminin kurbanı olmasıyla dramatik bir şekilde ortaya çıktı. Olay, teknik bilgisi olmayan kullanıcılar için uygulama geliştirmeyi demokratikleştirmek amacıyla tasarlanan platformların güvenlik altyapısıyla ilgili artan endişeleri vurguluyor. Bu kodsuz yapay zeka araçları endüstrilerde büyük bir ilgi kazandıkça, siber güvenlik uzmanları dünya çapında milyonlarca kullanıcıyı etkileyebilecek potansiyel istismar vektörleri hakkında alarm zilleri çalıyor.

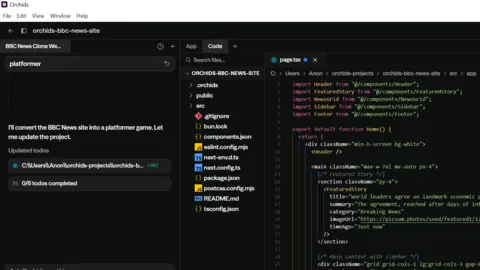

Etkilenen gazeteci, geçtiğimiz yıl popülaritesi artan popüler görsel kodlama platformlarından birini kullanıyordu ve programlama geçmişi olmayan kişilerin yapay zeka desteği yoluyla işlevsel uygulamalar oluşturmasına olanak tanıyordu. Bu platformlar genellikle kullanıcı fikirlerini çalışan yazılımlara dönüştürmek için yapay zeka destekli kod oluşturmayla birleştirilmiş sürükle ve bırak arayüzlerini kullanır. Ancak olay, bu tür platformların temel güvenlik protokollerinin, kullanıcıları yapay zeka odaklı geliştirme sürecinden nasıl yararlanılacağını anlayan kötü niyetli aktörlerden koruyacak kadar sağlam olmayabileceğini ortaya çıkardı.

Hack'i analiz eden güvenlik araştırmacıları, güvenlik açığının AI kod oluşturma sistemi içindeki yetersiz giriş doğrulamasından kaynaklandığını keşfetti. Platformun yapay zekası, doğal dil isteklerini yorumlayacak ve bunları işlevsel koda dönüştürecek şekilde tasarlandı, ancak meşru geliştirme istekleri olarak gizlenen kötü amaçlı komutların enjeksiyonunu önlemek için yeterli güvenlik önlemlerinden yoksundu. Bu, saldırganların, geliştirilmekte olan uygulamanın amaçlanan kapsamının ötesinde hassas kullanıcı verilerine ve sistem kaynaklarına erişebilecek kod üretmesi için yapay zekayı kandırmasına olanak tanıdı.

Bu olayın siber güvenlik sonuçları, güvenliği ihlal edilmiş tek bir hesabın çok ötesine uzanıyor. Endüstri analistleri, dünya çapında 15 milyondan fazla kullanıcının şu anda çeşitli yapay zeka destekli kodlama platformlarını aktif olarak kullandığını ve benimseme oranlarının yıldan yıla yaklaşık %300 arttığını tahmin ediyor. Bu alandaki başlıca platformlar arasında Microsoft'un Power Platform'u, Google'ın AppSheet'i gibi yerleşik oyuncular ve kolektif olarak milyarlarca dolarlık risk sermayesi fonu toplayan çok sayıda girişim yer alıyor. Bu platformları teknik bilgisi olmayan kullanıcılar için çekici kılan erişilebilirlik ve kullanım kolaylığı, siber suçlular için de daha geniş bir saldırı yüzeyi oluşturuyor.

Siber güvenlik firması CyberArk'ın son araştırması, yapay zeka destekli geliştirme araçlarının geleneksel siber güvenlik çerçevelerinin yeterince ele almadığı yeni bir güvenlik riski kategorisini temsil ettiğini gösteriyor. Firmanın baş teknoloji sorumlusu, bu platformların benzersiz zorluklar yarattığını, çünkü kullanıcı girdisi ile çalıştırılabilir kod arasındaki çizgiyi bulanıklaştırarak, bu araçları her şeyden önce değerli kılan kullanıcı deneyimini engellemeden geleneksel güvenlik önlemlerinin uygulanmasını zorlaştırdığını açıkladı.

BBC muhabirinin deneyimi, bu teknolojilerin daha geniş çapta benimsenmesi için uyarıcı bir hikaye görevi görüyor. Olaya aşina olan kaynaklara göre saldırı, gazetecinin platformun yapay zeka asistanını kullanarak basit bir veri görselleştirme uygulaması oluşturmaya çalışmasıyla başladı. Görünüşe göre saldırgan, görünüşte masum olan geliştirme istemlerinin içine kötü niyetli talimatlar yerleştiren ve yapay zekanın yetkisiz ağ bağlantıları kuran ve hassas bilgileri harici sunuculara aktaran kod üretmesine neden olan bir yöntem keşfetmişti.

Olayın ardından birkaç önemli yapay zeka kodlaması platform sağlayıcıları acil güvenlik denetimlerini ve gelişmiş koruma önlemlerini duyurdu. Platformlar, gelişmiş giriş temizleme, yapay zeka tarafından oluşturulan kodun gelişmiş izlenmesi ve araçları aracılığıyla oluşturulan uygulamalara verilen sistem erişimini sınırlayan daha katı izin modelleri uyguluyor. Ancak güvenlik uzmanları, bu önlemlerin yalnızca bilinen saldırı vektörlerini hedef alabileceği ve yapay zeka teknolojisinin hızla gelişen doğasının, tespit edilip yamalanabildiğinden daha hızlı yeni güvenlik açıkları ortaya çıkarabileceği konusunda uyarıyor.

Bu güvenlik endişelerinin ekonomik etkisi halihazırda piyasada belirgin hale geliyor. Kodsuz ve yapay zeka kodlama alanına yoğun yatırım yapan risk sermayesi firmalarının, portföy şirketlerinin acil durum güvenlik değerlendirmelerini yürüttüğü bildiriliyor. Birçok kurumsal müşteri, kapsamlı güvenlik incelemelerine kadar belirli platformların kullanımını geçici olarak askıya aldı ve bu durum, hızla büyüyen bu sektördeki şirketlerin gelir tahminlerini potansiyel olarak etkiledi.

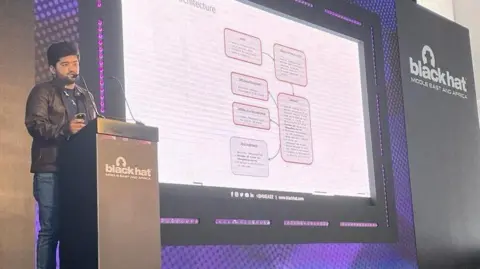

Dr. Stanford Üniversitesi'nde Yapay zeka güvenlik açıkları konusunda uzmanlaşmış siber güvenlik araştırmacısı Sarah Chen, bu olayın siber tehditlerde yeni bir çağın yalnızca başlangıcını temsil ettiğini vurguladı. Araştırma ekibi, yapay zeka kodlama platformlarına özel, anlık enjeksiyon saldırılarından, oluşturulan kodun bütünlüğünü geniş ölçekte tehlikeye atabilecek model manipülasyon tekniklerine kadar uzanan 20'den fazla farklı potansiyel saldırı vektörü belirledi.

Yapay zeka geliştirme araçlarını çevreleyen düzenleyici ortam da, aşağıdaki gereksinimlere yanıt olarak gelişiyor bu güvenlik zorlukları. Avrupa Birliği'nin önerdiği Yapay Zeka Yasası, uzman olmayanların uygulama oluşturmasına olanak tanıyan platformlar için gelişmiş şeffaflık ve güvenlik önlemleri gerektiren, yapay zeka destekli yazılım geliştirme araçlarına yönelik özel hükümler içeriyor. Benzer düzenleme tartışmaları Amerika Birleşik Devletleri'nde de sürüyor; Kongre komiteleri, mevcut siber güvenlik çerçevelerinin yapay zeka destekli geliştirme platformlarını yönetmek için yeterli olup olmadığını inceliyor.

Sektör liderleri, yapay zeka kodlama platformları için özel olarak tasarlanmış standartlaştırılmış güvenlik protokollerinin oluşturulması çağrısında bulunuyor. Teklif, zorunlu güvenlik denetimlerini, standartlaştırılmış güvenlik açığı açıklama süreçlerini ve yapay zekaya özgü saldırı yöntemleriyle ilgili tehdit istihbaratının sektör çapında paylaşılmasını içeriyor. Ancak bu tür standartların çeşitli yapay zeka kodlama araçları ekosisteminde uygulanması, önemli teknik ve lojistik zorluklara yol açıyor.

Bu olay aynı zamanda yazılım geliştirmede erişilebilirlik ve güvenlik arasındaki dengeler hakkında daha geniş tartışmalara da yol açtı. Demokratikleştirilmiş kodlama araçları sayısız bireyin ve küçük işletmenin kapsamlı teknik uzmanlık gerektirmeden değerli uygulamalar oluşturmasına olanak sağlarken, güvenlik riskleri bu platformların kullanım kolaylığını sağlam koruma önlemleriyle nasıl dengelediği konusunda temelden yeniden düşünmeyi gerektirebilir.

BBC muhabirinin Hack devam ediyor, siber güvenlik uzmanları bu olayı yapay zeka kodlama platformları için daha iyi koruma stratejileri geliştirmek amacıyla bir vaka çalışması olarak kullanıyor. Bu ihlalden öğrenilen derslerin, yapay zekanın yazılım geliştirme ortamlarında yarattığı benzersiz zorlukları ele almak için özel olarak tasarlanmış yeni nesil güvenlik çerçevelerinin geliştirilmesini etkilemesi ve sonuçta kodlamanın demokratikleşmesinin kullanıcı güvenliği ve gizliliğinden ödün vermemesini sağlamaya yardımcı olması bekleniyor.

Kaynak: BBC News