Yüksek Lisans Verimliliğini Artırın: Google'ın TurboQuant'ı Bellek Kullanımını 6 Kat Azaltır

Google'ın yeni TurboQuant algoritması, büyük dil modellerinin bellek alanını önemli ölçüde azaltarak doğruluktan ödün vermeden yapay zeka performansını hızlandırır.

Google Araştırmaları, Büyük Dil Modellerinin (LLM'ler) bellek kullanımını önemli ölçüde 6 kata kadar azaltabilen, aynı zamanda hızı artırıp doğruluğunu koruyabilen TurboQuant adlı çığır açan bir sıkıştırma algoritmasını ortaya çıkardı.

Doğal dil işleme ve oluşturma gibi gelişmiş dil görevlerini destekleyen yapay zeka modelleri olan LLM'ler, doyumsuz bellek gereksinimleriyle ünlüdür. Tekrarlanan hesaplamaları önlemek için önemli bilgileri saklayan anahtar/değer önbelleği, bu bellek tüketiminin arkasındaki ana suçludur. TurboQuant, performanstan ödün vermeden bu kopya kağıdı benzeri önbelleği sıkıştırarak bu zorluğun üstesinden gelmeyi amaçlamaktadır.

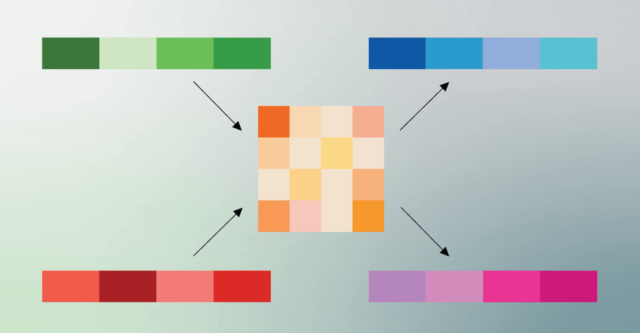

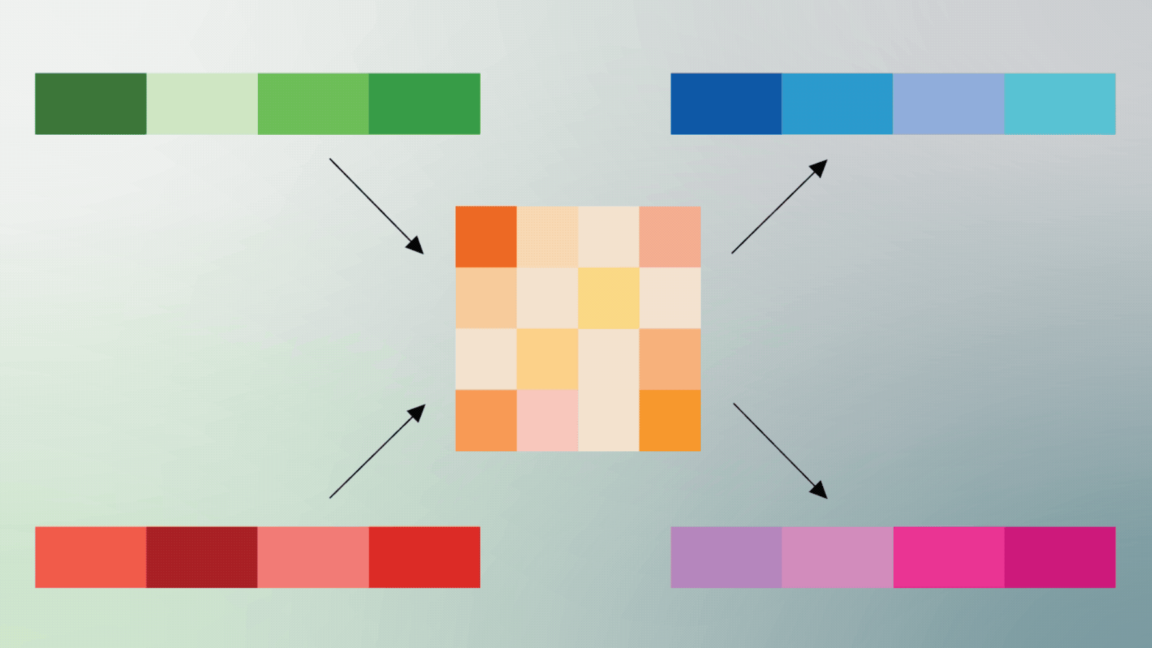

LLM'ler, simgeleştirilmiş metnin anlamsal anlamını haritalamak için yüksek boyutlu vektörlere güvenir. Yüzlerce veya binlerce yerleştirmeye sahip olabilen bu vektörler, görüntü pikselleri veya büyük veri kümeleri gibi karmaşık bilgileri tanımlamak için kullanılır. Bununla birlikte, aynı zamanda önemli miktarda bellek kaplarlar, anahtar/değer önbelleğinin boyutunu şişirir ve modellerin verimliliğini sınırlarlar.

Geliştiriciler, modelleri daha küçük ve daha verimli hale getirmek için sıklıkla kullanırlar Bu vektörlerin kesinliğini azaltmak için kuantizasyon teknikleri. TurboQuant, dil modelinin doğruluğundan ödün vermeden anahtar/değer önbelleğini 6 kata kadar küçültebilen yeni bir sıkıştırma algoritması sunarak bu kavramı bir adım daha ileriye taşıyor.

Bu atılımın yapay zekanın geleceği üzerinde önemli etkileri var. Yüksek Lisans'ların boyutu ve karmaşıklığı büyümeye devam ettikçe, bellek ayak izlerini önemli ölçüde azaltma yeteneği, yapay zeka performansında yeni sınırların kilidini açabilir ve bu da onu geniş bir uygulama yelpazesinde daha erişilebilir ve ölçeklenebilir hale getirebilir.

TurboQuant algoritması, anahtar/değer önbelleğini akıllıca sıkıştırarak, temel bilgileri korumak için gelişmiş tekniklerden yararlanırken genel bellek gereksinimlerini büyük ölçüde azaltarak çalışır. Bu yenilik yalnızca modellerin verimliliğini artırmakla kalmıyor, aynı zamanda gelecekte daha güçlü ve erişilebilir yapay zeka destekli çözümlerin yolunu da açıyor.

Yüksek performanslı, bellek açısından verimli yapay zekaya olan talep artmaya devam ederken Google'ın TurboQuant'ı, üretken yapay zeka ve ötesinin manzarasını yeniden tanımlayabilecek çığır açıcı bir katkı olarak öne çıkıyor.

Kaynak: Ars Technica