释放 Gemma 4 的力量:Google 的开放 AI 模型实现飞跃

谷歌推出了最新的 Gemma 4 开放权重 AI 模型,为开发人员提供了更多的自由和更高的性能。了解主要功能和许可更新。

Google 的 Gemini AI 模型在过去一年中取得了显着的进步,但其使用仅限于公司自己的条款。然而,新推出的 Gemma 4 开放权重模型为开发人员提供了更大的自由度和灵活性。

上一个版本,Gemma 3,在一年多前首次亮相,已经有些过时了。今天,开发者可以开始使用最新的 Gemma 4,它有四种不同的尺寸,每种尺寸都针对本地使用进行了优化。此外,Google 已经认识到开发人员在 AI 许可方面遇到的挫折,导致该公司放弃了自定义 Gemma 许可,转而采用更开放的 Apache 2.0 许可。

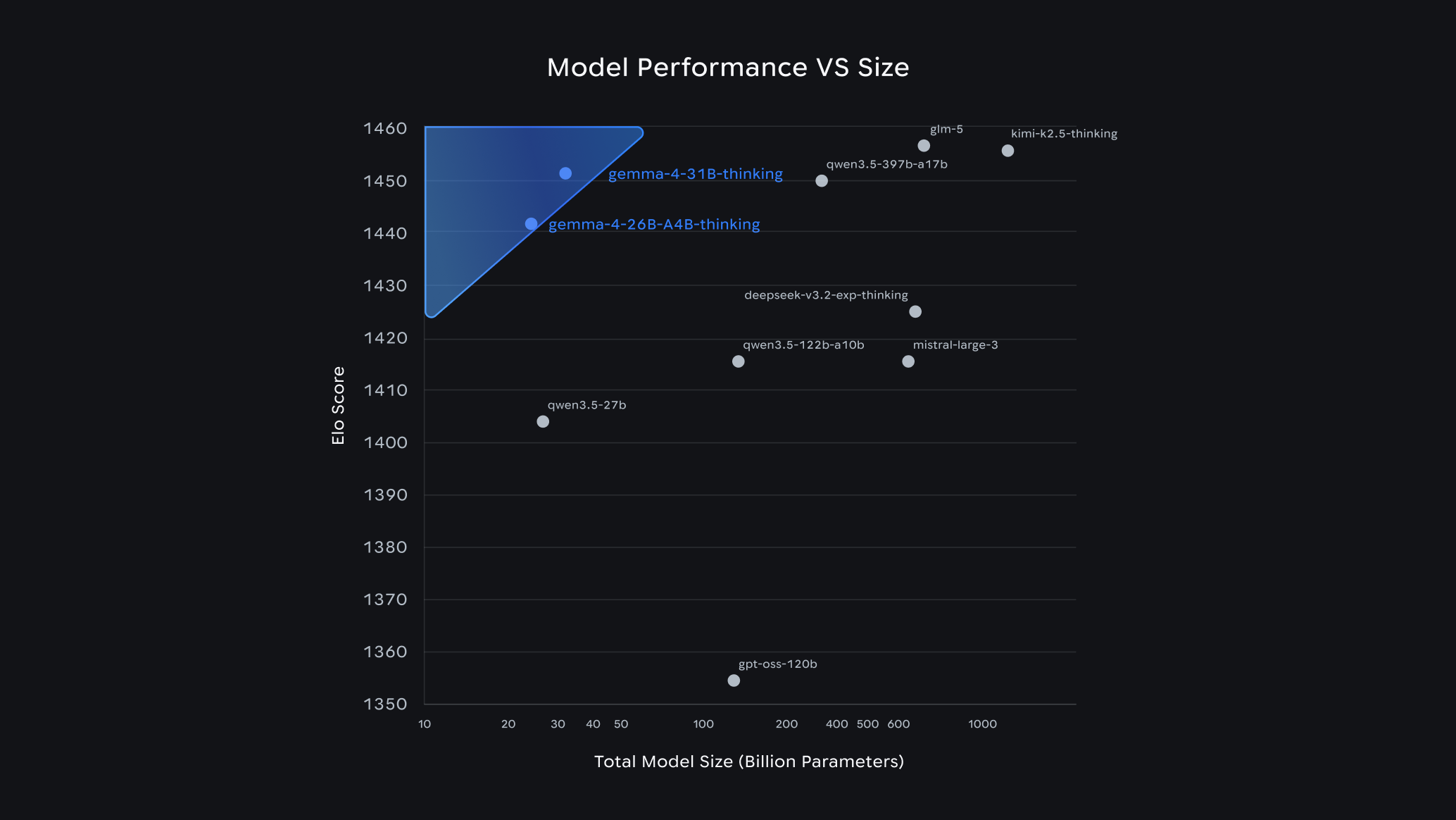

Gemma 4 的重点是它对本地机器的适应性。两个较大的变体,26B Mixture of Experts 和 31B Dense 模型,设计为在单个 80GB Nvidia H100 GPU 上以 bfloat16 格式运行非量化。虽然这种专用硬件的价格高达 20,000 美元左右,但它仍然代表了本地处理解决方案。

此外,Google 在减少 Gemma 模型的延迟方面取得了长足进步,使开发者能够真正利用本地处理的强大功能。例如,26B 专家混合模型在推理过程中仅激活 260 亿个参数中的 38 亿个,与类似大小的模型相比,每秒的令牌性能显着提高。

另一方面,31B Dense 模型代表了一种更全面的方法,可以在不牺牲效率的情况下提供更大的参数数量。大小和性能之间的这种平衡旨在满足更广泛的用例和开发人员的偏好。

向 Apache 2.0 许可证的转变是 Google 的一项重大举措,因为它解决了开发人员长期以来对 AI 许可的担忧。这种开源方法可以实现更大的灵活性和更广泛的采用 Gemma 模型,使开发人员能够探索它们并将其集成到他们的项目中,而受到更少的限制。

Gemma 4 的推出以及随附的许可更新表明了 Google 致力于推进 AI 领域发展并培育更加开放和协作的生态系统。随着开发人员深入研究这些新模型的功能,各行业的创新应用和突破的潜力必将扩大。

来源: Ars Technica